発表時間

| 論文 (Long) | 20分 |

| 論文 (Short) | 12分 |

| 国際論文誌・学会採択論文招待講演 | 12分 |

| SIGGRAPH招待講演 | 15分 |

口頭発表・招待講演プログラム

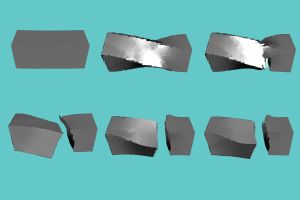

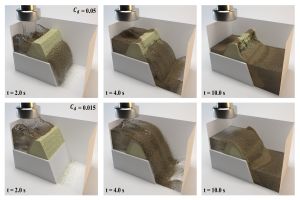

[1] 並列計算に適したメッシュレス破壊シミュレーション手法 (long)

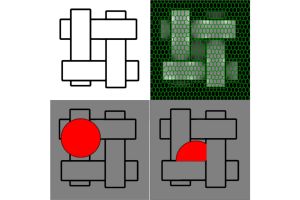

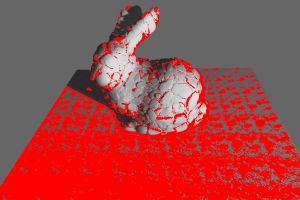

[2] 経年劣化に伴う金属物体上の塗膜の亀裂・湾曲表現—静力学的破壊判定と位置ベース変形による準静的過程のビジュアルシミュレーション— (long)

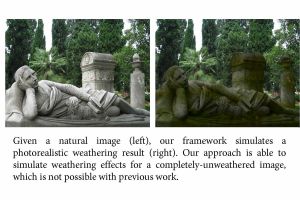

[3] Natural Image Weathering with a Generative Decay Network (short)

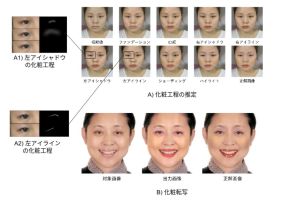

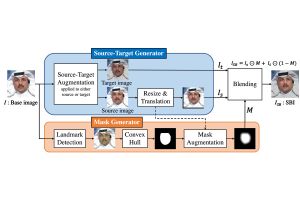

[8] 化粧工程の分解に基づく顔画像の化粧スタイル転写 (long)

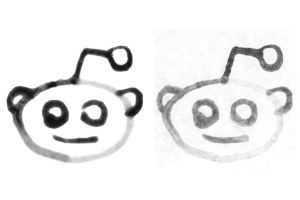

[9] Data-Driven Brushstroke Rendering for Real world nuance expression (long)

[10] 疑似相対深度推定によるイラストへの重なりを考慮した差し込み (short)

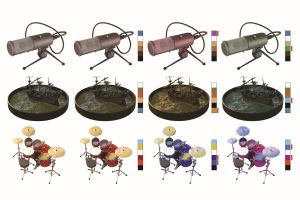

[12] Recolorable Posterization of Volumetric Radiance Fields Using Visibility-Weighted Palette Extraction (EGSR 2022)

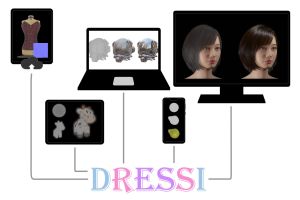

[13] Dressi: A Hardware-Agnostic Differentiable Renderer with Reactive Shader Packing and Soft Rasterization (EG 2022)

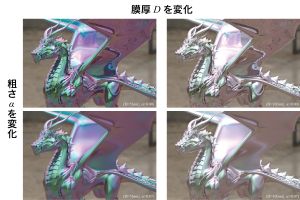

[16] スペクトラルイメージベーストライティングによる表面粗さを考慮した薄膜干渉の表示 (long)

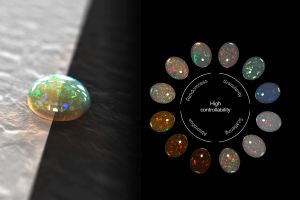

[17] 三次元ボロノイ分割を用いたオパールのビジュアルシミュレーション―遊色効果の再現― (long)

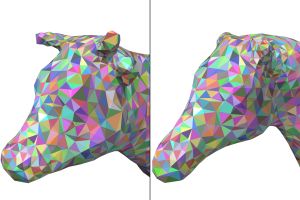

[18] コントラスト感度関数画像フィルタを用いたサポートベクタマシンによるリアルタイムなポリゴン分割制御 (short)

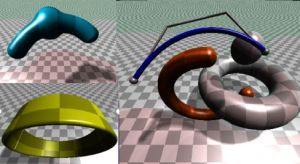

[19] レイマーチング法による円柱曲面・オフセット曲面の表示 (short)

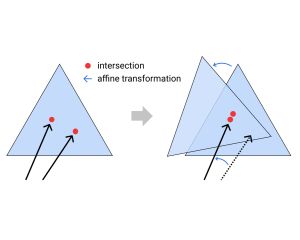

[20] レイ走査高速化のためのアフィン変換レイアライメント (short)

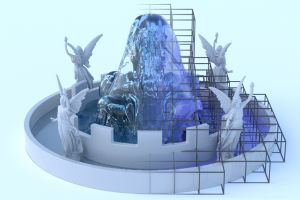

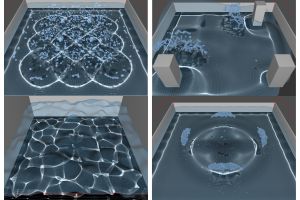

[21] しぶきを考慮したShallow Waterシミュレーションのための集光模様レンダリング (short)

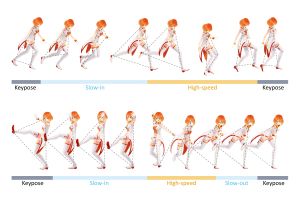

[27] 最適視点からのポーズ抽出を伴うセルアニメ風モーション変換―速さ分布とポーズ面積に注目した動作評価 (short)

[28] 運指と運弓を反映した音響信号からのヴァイオリン演奏アニメーションの自動生成 (short)

[29] DVF:ハンドジェスチャインタフェースを用いた仮想シーン知覚像のスケール再現に向けて (short)

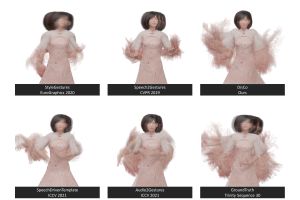

[30] BEAT: A Large-Scale Semantic and Emotional Multi-Modal Dataset for Conversational Gestures Synthesis (ECCV 2022)

[32] DisCo: Disentangled Implicit Content and Rhythm Learning for Diverse Co-Speech Gestures Synthesis (ACMMM 2022)

[36] BO as Assistant: Using Bayesian Optimization for Asynchronously Generating Design Suggestions (UIST 2022)

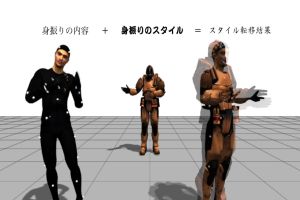

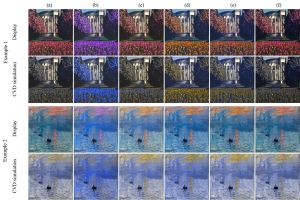

[38] Tool- and Domain-Agnostic Parameterization of Style Transfer Effects Leveraging Pretrained Perceptual Metrics (IJCAI 2021)

[39] ユーザ制御可能なLatent Transformer を用いたStyleGAN 画像のレイアウト編集 (long)

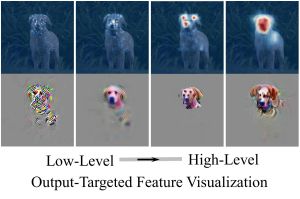

[40] Region-conscious visualization of output-targeted neuron features (short)

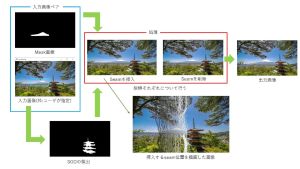

[42] 知覚サイズを反映した写真生成のための画像自動部分拡大方法 (short)